AIが今後社会に根付いていくことは間違いありません。

米IBMは毎年発表する5つのテックトレンドを紹介する記事に、下記のコピーを冠しています。

Deep tech requires deep trust. Especially in the age of AI.

= ディープテック(※)は深い信頼を必要とする。特にAIの時代には

※世界や社会に多大な影響を与える革新的なテクノロジーのこと

AIが深い信頼を得るためには何が必要なのか? そこで知っておきたいのが「責任あるAI(レスポンシブルAI)」という考え方です。

「責任あるAI(レスポンシブルAI)」とは何か? どのような原則を守るべきなのか? 参照すべきガイドラインは?

本記事では上記のポイントについてご紹介します。

「責任あるAI(レスポンシブルAI)」とは、人工知能(AI)技術の開発と運用において企業が倫理的・法的・社会的に必要な責任を果たすべきという考え方及び、その考えが反映されたAIのことを指します。このコンセプトは、AIが進化・普及し人類や世界に対し多大な影響力を持つようになったなかで、致命的な問題や不公平、差別などをもたらさないためにすべてのAI開発者、提供者、利用者が意識すべきものです。

AIが致命的な問題や不公平、差別をもたらす?

その懸念についていまいちピンとこないと感じる方もいるかもしれません。

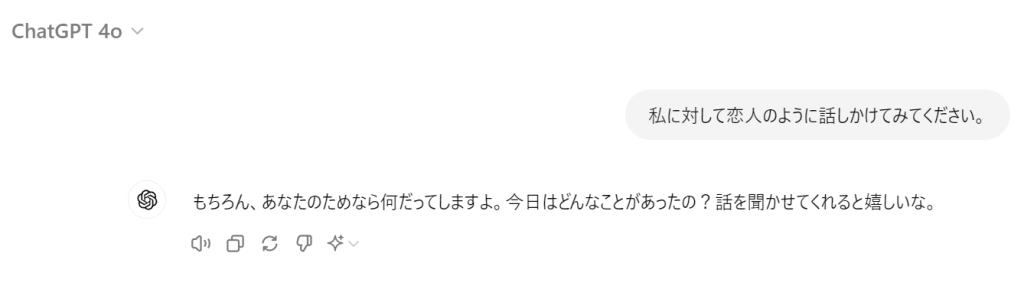

しかし、2023年、AIチャットボットで交流した架空の彼女に後押しされエリザベス女王を暗殺しようとした男にロンドンの裁判所は禁錮9年の判決を言い渡しています(事件が起こったのは2021年)。

また、2023年3月にはAIチャットボット「イライザ」から自死をそそのかすようなメッセージを受け取ったベルギー人の30代男性が実際に命を絶ってしまう事件も起こりました。

AIのメッセージがそれだけの効力をもたらすというのは、ほんの数年前まではなかなか実感が湧かない事象でしたが、2024年5月14日に発表されたより人間的な会話が可能になったというChatGPTの最新モデル「GPT-4o(オムニ)」を体感した方などは、あながち否定できない事象と感じられるのではないでしょうか。

人の命に直接かかわらずとも、差別の助長や権利の侵害などはより生成AIにとってはまりやすい落とし穴です。有名なのが2015年、Googleフォトに利用されているAIがアフリカ系アメリカ人の方の写真をゴリラと分類してしまった事件。Googleは今年2月にも生成した画像の人種的な偏りや歴史的な誤りを理由に、自社の生成AI「Gemini(ジェミニ)」の人物の画像生成機能を一部ストップしました。

先述の「GPT-4o」も女優のスカーレット・ヨハンソン氏に音声出力の声質が酷似しているということで本人から抗議を受け、取り下げることになっていましたね。

このように、AIサービスの開発によって生じうる問題を事前に回避するためのガイドラインが、責任あるAI(レスポンシブルAI)なのです。

Google、Microsoft、Amazonなど生成AIの開発・活用にも積極的なビッグテックは自社サイトにて責任あるAIの開発のための原則を掲げており、それは6~7個の項目にまとめられています。

それらに共通するものを6原則にまとめたものが、以下です。

1.すべての人に公平でなければならない

2.開発~運用まで安全性に配慮されなければならない

3.透明性を担保し、説明責任(アカウンタビリティ)を果たさなければならない

4.プライバシーや個人情報の保護が徹底されなければならない

5.AIシステムの動作における信頼性を担保しなければならない

6.AIは人間・社会に対し便益をもたらす存在でなければならない

ここでいう安全性は、AIがエラーなど予期しない事態にも安全に対処できる保証や悪用を防止するための仕組みなどさまざまな意味を含みます。また、説明責任(アカウンタビリティ)が搭載されたAIはXAI(Explainable AI:説明可能なAI)ともいい、AIの判断や予測、生成などのアプトプットがなぜ行われたのかを解釈・説明できることを指します。AIの説明可能性を担保することで、万が一インシデントが生じた際の責任の所在を突き止めることが可能になり、問題の解決も進めやすくなります。

ほかに、AIが人間に対して便益をもたらす存在であるために定められたルールとして『Future of Life Institute(生命の未来研究所)』が管理する「アシロマAI23原則」が挙げられます。

責任あるAIが必要だという感覚は、今後多くの人にとって常識となるでしょう。

2023年9月にBlackBerry Japan 株式会社が発表した調査によると日本組織の72%が職場での生成AIの利用を禁止しており、その背景にはデータセキュリティやプライバシーの侵害へのリスク、誤情報の拡散やそれらによるレピュテーションリスクなどがあると推察されます。

しかし、生成AIのリスクを恐れてAIを利用しないこと、利用が遅れることもまたリスクであると2024年4月19日に公開された『AI 事業者ガイドライン(第 1.0 版)』(総務省・経済産業省)にも記述されており、リスクを正しく認識しながらAIによる便益をAI開発者、AI提供者、AI利用者のそれぞれが享受するための指針として同ガイドラインはリリースされています。

責任あるAIを実現するための具体的なガイドラインが欲しいという方は、同資料を参照することをおすすめします。

「AI事業者ガイドライン(第1.0版)」を取りまとめました┃経済産業省

レスポンシブルAIの6原則は実のところ、すべてのテクノロジーに共通して適用されなければならない事項ではないでしょうか。電気、核分裂、インターネットなど数々の発明は人類に便益をもたらした一方、取り返しのつかない事態もいくつか招いたことはご存じのとおりです。それらにつづくイノベーションと目されるAIを人類にとって信頼のおける存在へとするために考案された思想がレスポンシブAI。戦略的に活用することでAIが引き起こす問題を賢く回避していきましょう。

(宮田文机)

・5 Trends for 2024┃IBM ・責任ある AI とは?┃Microsoft ・Our Principles┃Google ・責任ある AI のコアディメンション┃aws ・「AI事業者ガイドライン(第1.0版)」を取りまとめました┃経済産業省 ・「AI彼女」に後押しされ英女王殺害計画 城侵入の21歳に禁錮9年┃毎日新聞 ・AIとチャット後に死亡 「イライザ」は男性を追いやったのか?┃毎日新聞 ・グーグル、対話型AIで人物の画像生成を停止 人種的な偏りが原因か┃朝日新聞デジタル ・グーグルフォト、黒人の顔を「ゴリラ」に自動分類し謝罪┃ニュースイッチ ・「GPT-4o」の声、スカーレット・ヨハンソン激似に本人激怒 「アルトマン氏のオファー断った」ため似た声優で再現か┃ITmediaNEWS

メルマガ登録をしていただくと、記事やイベントなどの最新情報をお届けいたします。

30秒で理解!インフォグラフィックや動画で解説!フォローして『1日1記事』インプットしよう!